��д�κ�һ��������ʱ����֪��ʵ�ֺ�����ܵ���������һ������¿���ͨ��һ���ļ�ʱ��ȷ�������Ǻ��ǻ��������ڱ�д����Ӧ����˵ȷ���ⶫ������������ԱȽϸ���һЩ���е��˻����Ƿ��ܴﵽij������ֵ���Ƿ�֧�ֶ���������ȷ�������ܺã��ã��ںͺܶ����ѽ����Ĺ��̷������Ƕ��ⷽ����˽����һЩ����������ΪֻҪ��ǧ�״���������֧�ֶ��ٸ����ӽ�����У���ʵͨ����ֵ��ȷ��һ����������ܺò����Ƿ�ɿ��أ�����ͨ��һЩ��������������ָ��ֵ���������ܵĿɿ��ԡ�

����

����.NET������˵����ǧ�״�������˵��һ����������,Ҳ����˵��һ���dz����ѵ�����.

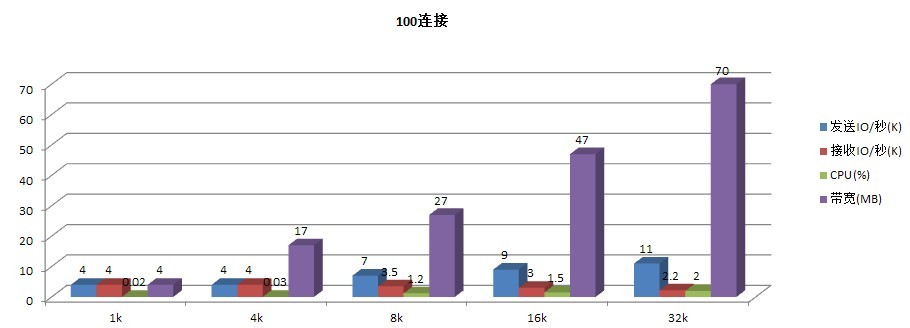

������100�����Ӵӷ���˻�ȡ��ͬ���ݿ�IJ��Խ��.

�ֱ�����˻�ȡ��ͬ��С�����ݿ�,���Կ���ֻҪ�ѷ��͵����ݿ�Ӵ��ǧ�״�������������һ���dz�������.�����ÿ�������ȡ�����ݴ�С�ڼ���byte��ʮ��byte,ͨ��.NET�������ǧ�״������������Dz�̫���ܵ�����,�������������úõĻ�Ҳ���ǿ��Ե�....����Ȥ�����ѿ�������

������

���������ָ���ں�һЩ���ѽ�̸�����ƺ�Ҳ������,��ʵ��.net�Ļ��������������Ķ����ƺ�����������û�ж���Ӱ��.ͨ������������Խ�����Կ���:

�����ϲ����������,1000���Ӻ�20000�����ڴ�����ͬ���պͷ������������CPU��Դ�ƺ�������������ж��IJ���,��Ҳ����IOCP��ǿ��֮��.

�ܽ�

�������������Խ���������Եõ��Ĵ���,����.net��д����ͨѶӦ��Ч�ܵ�һ���dz���Ҫ��ָ����IO��������,����ӦSocket����Ķ���д����.�ڲ��ԵĹ����������������������ϵͳ�жϴ���,�����Щ���������ܴ��������жϵ����Ҳ������,����Ӧ������������²ü�������IO�����Ĵ�����Գ���Ч�����ż�������(��һ��ʱ���ڷ���ijһ���ӵ���Ϣ�ϳ�һ������).

��.NET��IO������������Ŷ�����?����һ̨װ��WIN2008��E3 1230V2�Ļ���,���˴�ſ��Դ�������(10W����+10W����)/��.��Ȼ����ͨ��������������Ϻ���,���Ų������������������������,��Ӧ�̵߳����Ӻ�ϵͳ�ж�Ҳ������,��Щ�����������Ƿ����Ե�.

ϲ��

ϲ��  ��

�� �ѹ�

�ѹ� ��

�� ��

�� ����

����